Graph Anomaly Detection with Few Labels - AData-Centric Approach

文献地址:Graph Anomaly Detection with Few Labels: A Data-Centric Approach

介绍

这篇论文针对静态图上的异常节点检测任务,提出了一种数据为中心的解决方案。

传统方法通常面临两个挑战:异常节点的稀缺性和高昂的标注成本,导致数据不平衡且难以通过少量标签进行有效学习。因此许多研究接受了这些以数据为中心的挑战,作为图异常检测的事实设置,并追求实现更复杂的图学习算法来检测具有少量标签的图异常。

我们将重点放在生成紧密复制原始图形分布的训练节点上。与以前的以模型为中心的策略不同,我们的方法是以数据为中心的,因为我们优先考虑合成数据的生成和利用,以应对数据稀缺的挑战。然而这种方法会引起两个基本问题:

第一,确保合成数据紧密复制图数据的复杂特征的挑战;

第二,合成数据是否有利于图异常检测。

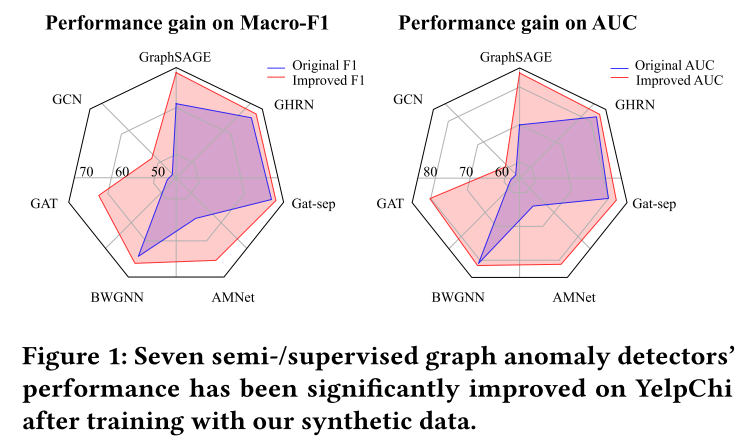

为了解决这些问题,本文提出了一种基于去噪扩散模型的图生成方法,生成与原始图拓扑和属性分布相符合的辅助训练节点。通过这些生成的节点,现有的异常检测模型可以在少量标签条件下显著提升性能。

我们确定了去噪神经网络应该具备的两个原则:

第一,保留每个节点与其邻居的特征不相似性(捕获局部图语义);

第二,恢复低频图形能量。

根据这些原理,提出了一种基于无条件去噪的图扩散模型GenGA和一种分类器引导的生成模型CGenGA,用于生成适合图异常检测的数据。

论文的贡献包括:

- 提出了一种数据为中心的图异常检测方法,通过生成合成数据来增强现有检测器。

- 基于实验观察提出了两条设计去噪神经网络的原则,用于生成合成训练样本。

- 在八个常用数据集上的实验表明,生成的数据有效提高了九种前沿图异常检测器的性能。

相关工作

2.1 图异常检测

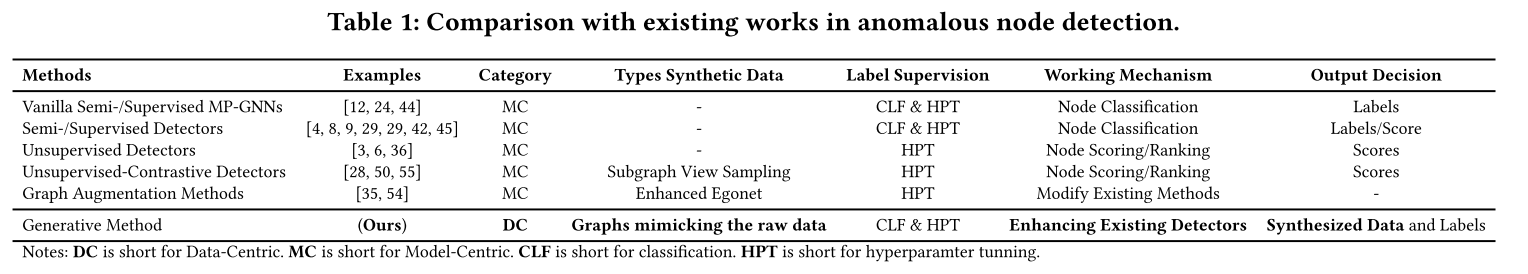

在图异常检测领域,本文通过表格列举了几类常见方法及其对应的例子。以下是对文中提到的相关方法及其例子的总结:

1. Vanilla Semi-/Supervised MP-GNNs(基础的半监督/监督图神经网络)

- 这些方法主要依赖节点分类,使用少量标注的异常节点进行训练,分类边界是基于图神经网络(GNN)的。

- 例子:参考文献 [12, 24, 44] 中讨论了这些方法的具体实现。

2. Semi-/Supervised Detectors(半监督/监督检测器)

- 这些检测器通过少量标注的异常节点,学习异常与正常节点之间的分类边界。它们不仅进行分类,还依赖于超参数调整(HPT)。

- 例子:参考文献 [4, 8, 9, 29, 42, 45] 提供了具体实现,展示了如何通过少量标签进行异常检测。BWGNN [42]采用Beta图小波并利用少量标记的异常来学习带通滤波器以捕获异常信号,GHRN [8]进一步应用图小波来解决图的异质性。

3. Unsupervised Detectors(无监督检测器)

- 这些方法不依赖标签,直接通过节点的评分或排名来判断异常。通常,它们会基于特定的特征和图结构的偏差来检测异常。

- 例子:参考文献 [3, 6, 36] 中展示了这种无监督检测的具体实现。例如CONAD [28]和SL-GAD [55],它们在不同的对比视图中调查异常及其邻居之间的一致性,以测量节点不规则性。其他人如[6]、[25]和[55]将残差量化为异常评分的测量。

4. Unsupervised-Contrastive Detectors(无监督对比检测器)

- 这些方法通过对比不同视角下的节点相似性或差异性,来判别哪些节点表现异常。通常使用子图视角采样(Subgraph View Sampling)技术。

- 例子:参考文献 [28, 50, 55] 中对这些方法进行了具体讨论。

5. Graph Augmentation Methods(图增强方法)

- 图增强方法通过增强图的局部结构(如egonet增强),提升模型的检测效果。虽然没有生成合成数据,但通过改进现有结构获得更好的检测性能。

- 例子:参考文献 [35, 54] 中讨论了图增强方法的不同实现。

6. Generative Method(生成方法,本文提出)

- 本文提出的生成方法属于数据为中心(DC),通过生成与原始数据分布相似的合成图,增强现有检测器的性能。这种方法生成了新节点和标签,并能够提升分类任务和超参数调整的效果。

- 例子:此方法为本文的核心创新,旨在解决标签稀缺问题。

2.2 去噪扩散概率模型

去噪扩散概率模型(Denoising Diffusion Probabilistic Models,DDPM)最近在多个生成任务中展现了强大的能力,包括图像合成、时间序列预测等。DDPM包含两个过程:前向扩散过程(forward process)和反向去噪过程(reverse process)。

1. 前向扩散过程

前向扩散是一个多步的马尔可夫链过程,在每一步中,模型通过向节点属性逐步添加噪声来生成一个标准正态分布。对于某个初始节点属性 ,经过 步后,扩散到 :

其中, 是每个时间步的噪声增加比例。

2. 反向去噪过程

反向去噪过程的目标是从最终的噪声分布 开始,通过逐步去除噪声,恢复原始的数据分布。反向过程同样是一个马尔可夫链过程,模型通过学习去噪的条件概率分布 来实现:

其中, 和 是通过神经网络学习的去噪均值和方差参数。

3. 去噪过程中的损失函数

为了让模型能够有效地学习去噪过程,DDPM使用了以下损失函数:

其中, 是加性噪声, 是模型预测的噪声。这个损失函数衡量了模型在每个时间步去除噪声的能力。

4. 在图数据中的应用

在图异常检测任务中,DDPM被用于生成与原始图分布一致的合成节点数据。前向过程逐渐将噪声添加到节点属性中,而反向过程则通过去噪逐步恢复出符合图结构的节点,从而生成新的训练样本。

这种去噪生成方法能够有效地缓解异常检测中的标签稀缺问题,并提升检测模型的性能。

第三部分:准备工作

3.1 静态属性图

一个静态属性图可以表示为 ,其中 表示图的邻接矩阵, 表示节点的属性矩阵。图中共有 个节点,每个节点都有与其相关的属性特征。

3.2 Egonet差异性

Egonet差异性用于衡量某个节点与其Egonet邻居之间的属性差异。Egonet可以理解为以节点为中心的局部网络结构。定义Egonet差异性为:

其中, 是归一化图拉普拉斯矩阵, 是节点的属性特征矩阵, 是度矩阵, 是邻接矩阵。该公式量化了每个节点与其邻居之间的属性差异。

3.3 前向扩散过程

在前向扩散过程中,噪声逐渐被注入到节点的属性矩阵 中,随着扩散步骤的增加,节点的属性逐渐接近正态分布。这个过程可以通过以下方式描述:

通过 步的扩散,原始节点属性会变成一个接近噪声的分布。

3.4 少量标签下的图异常检测

图异常检测任务的目标是在图 中识别异常节点,异常节点通常表现出不同于正常节点的结构和属性模式。为了检测异常,模型需要学习一个函数 ,其中 表示异常节点, 表示正常节点。

在少量标签的设定下,异常节点的数量远少于正常节点,即 ,这是一个不平衡的分类任务。

4 设计动机和分析

4.1 Egonet差异性的演变

在前向扩散过程中,异常节点和正常节点的属性发生了不同的变化,特别是在节点的Egonet差异性方面。实验表明,异常节点的Egonet差异性在扩散过程中变化更加剧烈,而正常节点的差异性则相对稳定。

具体来说,Egonet差异性定义为:

在实验中,作者测量了异常节点和正常节点的平均Egonet差异性,并发现随着扩散步骤的增加,异常节点的差异性显著增大。因此,去噪神经网络需要具备捕捉局部图语义信息的能力,才能更好地恢复这些差异。

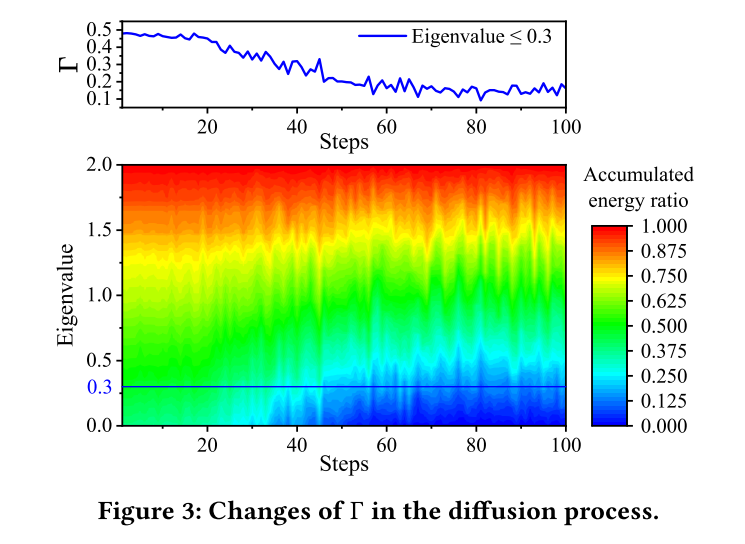

4.2 图谱能量的转移

作者进一步分析了扩散过程中的图谱能量变化。通过傅里叶变换,可以将图信号分解为不同频率的分量。实验表明,扩散过程中,低频信号的能量逐渐减少,而高频信号的能量逐渐增加。

在每一步扩散中,节点属性的图谱能量可以表示为:

其中, 是图信号在傅里叶空间中的表示, 是图拉普拉斯矩阵的特征向量矩阵。

实验结果显示,随着扩散步骤 的增加,图信号的高频分量逐渐占据主导地位。去噪过程需要能够恢复低频能量,以确保生成的图与原始图拓扑结构保持一致。

4.3 设计原则总结

基于对Egonet差异性和图谱能量变化的分析,作者提出了两个设计去噪神经网络的原则:

- 局部信息捕捉:去噪神经网络需要能够捕捉节点与其Egonet邻居之间的差异性,确保在合成图中保留局部语义信息。

- 低频能量恢复:去噪神经网络需要能够恢复扩散过程中丢失的低频能量,保证生成的节点与原始图的拓扑结构保持一致。

这些原则为后续提出的去噪神经网络设计提供了理论依据,并有助于生成高质量的合成数据。

5 方法

根据我们制定的设计原则,本节首先介绍我们无条件的图生成模型 GenGA,这是一个基于去噪的神经网络,旨在生成辅助训练样本,即节点。然后,我们提出了 CGenGA,通过引入分类器引导数据生成。最后,我们讨论生成的图如何用于补充现有的检测器。

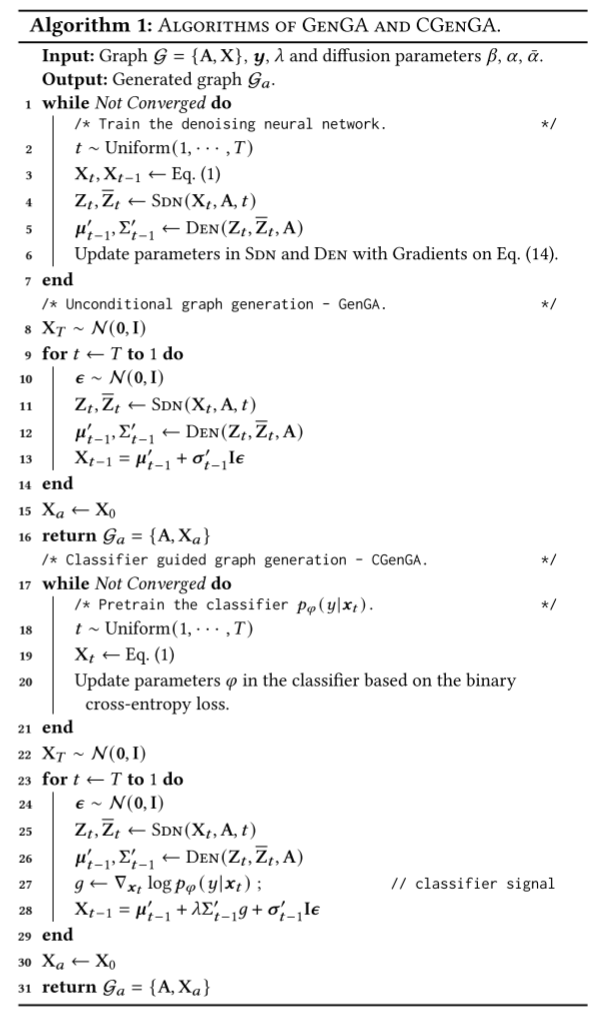

5.0 GenGA和CGenGA的算法分析

该算法描述了生成图数据的两个过程:GenGA 和 CGenGA,分别用于无条件图生成和分类器引导的图生成。以下是对算法的逐步分析与讲解:

输入和输出

- 输入:

- 图 :表示输入的图数据,包含邻接矩阵 和生成的节点特征矩阵 。

- 扩散参数: 是扩散模型中使用的参数,控制噪声的扩散与消除。

- 分类器相关的参数:、。

- 输出: 生成的图 ,其中包含邻接矩阵 和生成的节点特征矩阵 。

主要步骤

1. 去噪神经网络的训练

在整个图生成过程中,首先是训练去噪神经网络(如 SDN 和 DEN),以学习如何去除扩散过程中加入的噪声,恢复图的节点特征。

- Step 1-7:

- 初始化时间步 :从均匀分布中采样一个时间步,表示当前扩散阶段。

- 计算 和 :根据扩散方程 (1) 更新节点特征。

- 利用 SDN 和 DEN 计算节点表示 和 ,并估计 (均值与方差)。这里的估计用于恢复噪声污染的特征。

- 使用公式 (14) 通过梯度更新 SDN 和 DEN 中的参数,完成去噪网络的训练。

2. 无条件图生成(GenGA)

具体步骤为:

- Step 8-16:

- 从标准正态分布 中采样 ,作为生成过程的初始输入。

- 依次回溯扩散过程,从 生成 ,每一步都通过 SDN 和 DEN 预测均值和方差,并根据扩散方程恢复节点特征。

- 最后,得到合成图的节点特征矩阵 ,并返回生成的图 。

3. 分类器引导的图生成(CGenGA)

在 CGenGA 中,除了基本的去噪和生成步骤外,还加入了一个额外的分类器引导步骤。通过预训练分类器,利用分类器信号 来指导生成过程,进一步改善生成图的质量。

- Step 17-31:

- 在分类器引导的生成过程中,首先进行分类器的预训练,基于图中的节点特征进行分类任务。

- 然后与无条件生成类似,从 开始逐步生成 ,不过此时加入了分类器信号 ,它引导生成过程,以偏移节点特征的均值 。

- 最后生成的节点特征矩阵 同样作为最终的生成图的一部分,返回 。

总结

- GenGA 过程通过无条件去噪扩散模型生成合成图,主要依赖 SDN 和 DEN 进行节点特征的去噪和恢复。

- CGenGA 在 GenGA 的基础上引入了分类器引导,通过预训练的分类器信号 来引导生成过程,使得生成图能够更好地拟合目标分布,从而提升图异常检测的性能。

该算法通过结合去噪扩散模型和分类器信号,解决了图数据生成中的数据稀缺问题,并且能够通过生成更多样的图数据来增强现有的异常检测器。

5.1 去噪神经网络设计

根据定义3,我们仅在扩散过程中向节点属性注入噪声,因此可以应用任何类型的神经网络来去噪 。具体而言,去噪过程实际上是在预测来自图 的均值 和方差 。

然而,正如我们在设计原则P2中提到的,去噪网络的选择受到恢复低频能量需求的限制。图卷积神经网络(GCN)作为一种有效的低通滤波器,能够抑制高频信号并强调低频信号,因此是去噪网络的强候选者。此外,从空间角度来看,GCN能够传播局部图语义,从而更好地保留图结构。因此,我们选择GCN作为主干网络,并设计了两种成分,即依赖步骤的GCN(SDN),用于学习节点表示 ,以及分布估计器(DEN),用于估计 的均值和方差。

5.2 依赖步骤的GCN - SDN

我们基于[23]构建了 SDN,目标是学习符合高斯分布 的节点表示,其中矩阵 和 包含每个节点在步骤 时的表示的均值和方差。

由于 是一个标量,且需要进一步注入对时间步 的依赖性,因此我们引入了编码函数 TE,用于生成特定时间步 的嵌入矩阵。编码函数的公式如下:

其中, 和 是可训练的投影参数。 是正弦函数,且 的嵌入由以下公式定义:

我们然后学习节点表示的均值 和方差 ,公式如下:

其中,, 是归一化的邻接矩阵。 是GCN层的可训练变量。通过重新参数化技巧,表示 可以有效捕捉局部图结构。

5.3 分布估计器 - DEN

给定节点表示 ,我们提出了一个分布估计器,用于预测 的均值和方差。具体来说,预测的均值为:

其中, 表示连接操作。值得注意的是,我们从 SDN 中提取出这个残差信息以缓解过平滑现象,并通过第6.4节的消融研究验证了其有效性。

方差估计公式如下:

其中, 是 DEN 中的可训练参数。

5.4 训练准则

最终,所有 SDN 和 DEN 中的参数可以通过最小化预测的 和有噪声的 在任意步骤 下的分布之间的KL散度来调整,公式如下:

5.5 无条件图生成 - GenGA

当整个模型在不同的步骤 上充分训练后,我们可以简单地从 中采样 ,并通过 SDN 和 DEN 逐步估计 的均值和方差,从而生成一个新图 ,该图的节点和特征数量与原始图相同,公式如下:

其中,, 是从标准高斯分布中采样的。

5.6 分类器引导生成 - CGenGA

虽然 GenGA 可以从噪声中生成辅助图,但它忽略了用于引导图生成的类别信息。在这里,我们进一步探索通过将生成过程与类别信息进行条件化,结合分类器引导数据生成,公式如下:

根据[5],每个反向步骤的目标如下:

其中, 是常数,。这里, 是涉及的分类器信号,即分类器在数据 上的导数 ,分类器 在有噪节点属性 和节点标签 上训练。

通过分类器的引导,会对无条件生成器的均值进行偏移, 以及去噪节点属性矩阵 最终可以通过以下公式得到:

其中, 是一个超参数,用于平衡分类器信号的权重。

5.7 使用合成数据增强图异常检测

为了增强给定的异常检测器 ,我们可以简单地将生成的图 输入到原始图 中,并通过最小化原始损失函数(如二元交叉熵损失)来微调参数。总训练损失的通用形式可以写为:

其中,第一项衡量在原始图上的训练损失,第二项计算在合成图上的损失。

5.8 复杂度分析

我们方法的主要计算成本来自于去噪神经网络(生成模型)、图生成以及分类器训练(用于 CGenGA 中的分类器引导)。对于生成模型,时间编码函数 TE 的整体复杂度为 ,由于 SDN 和 DEN 采用GCN作为主干网络,因此每次训练迭代的成本约为 ,其中 是图中节点的数量, 是节点属性的维度, 是GCN层的维度。图生成阶段涉及 SDN 和 DEN 进行推理,总体生成一个图的成本约为 ,其中 为扩散步骤数。使用GCN作为 CGenGA 中的分类器时,每次迭代的训练成本为 。

6 实验

在本节中,我们进行了广泛的实验来回答以下研究问题:

- RQ1: 生成的图在提升现有异常检测器性能方面有多大效果?

- RQ2: 分类器信号是否能够丰富生成的图?

- RQ3: 去噪神经网络中的残差连接和参数 对性能提升有何影响?

- RQ4: 线性和余弦调度器对性能的影响如何?

- RQ5: 随着更多合成数据的加入,检测性能是否能进一步提高?

- RQ6: GenGA 和 CGenGA 能以多快的速度生成图?

- RQ7: GenGA 相比其他图数据增强方法效果如何(见附录A.3)?

6.1 实验设置

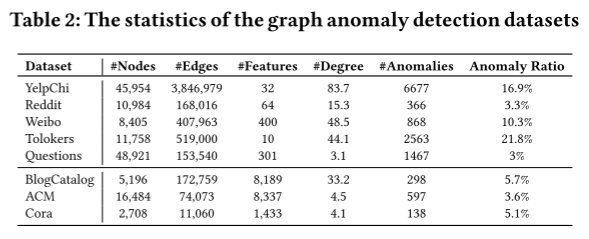

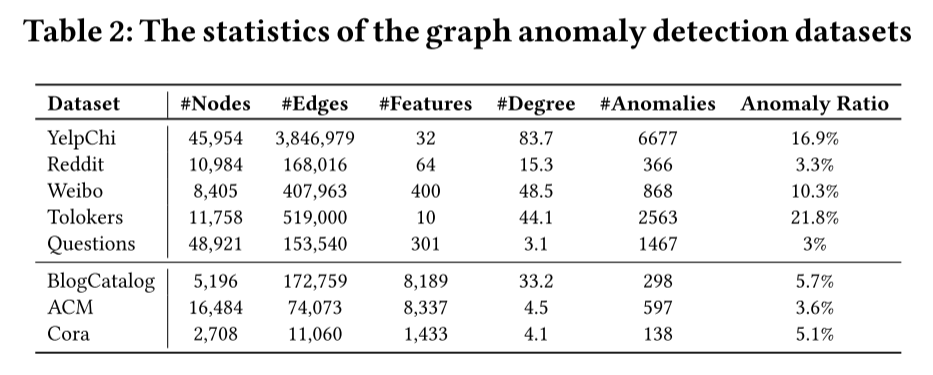

数据集: 我们包括了八个常用的图异常检测数据集进行评估。具体来说,这些数据集可以分为两类:一类是有机异常,包括 YelpChi、Reddit、Weibo、Tolokers 和 Questions;另一类是注入异常的数据集,如 BlogCatalog、ACM 和 Cora。数据集的统计信息如表2所示。

实现细节: 在所有实验中,我们将 SDN 和 DEN 中的GCN层的维度设置为256和128。我们在前向扩散过程中设置了1000个步骤。对于 CGenGA,我们实现了两层GCN作为指导分类器,对于 CONDAD 和 CoLA,我们根据标记节点上的结果确定其分类阈值。

现有检测器: 为了评估我们生成的合成数据的有效性,我们采用了三种基于 GNN 的检测器,分别是基于 GCN、GAT 和 GraphSAGE 的方法;此外,还包括四种最新的半监督/监督异常检测器:BWGNN、GAT-sep、AMNet、GHRN,以及两种无监督检测器:CONAD 和 CoLA。除非特别说明,否则我们在实验中使用一个合成图。更多细节请参见附录A.2。

图数据增强方法: 为了验证我们设计的基于扩散模型的图数据生成方法,我们将我们的模型与 VGAE 和非生成式图增强方法 GraphENS 进行比较,后者用于处理图中的类别不平衡学习问题。由于 GraphENS 和 VGAE 不涉及分类器引导训练,因此我们仅与 GenGA 进行比较。

实验细节: 我们严格按照第5.7节的设置,在使用20%标记节点的场景下训练 CGenGA 和所有现有检测器(不包括 CONAD 和 CoLA)。

6.2 异常检测性能提升 (RQ1)

表3、表4和表5(附录A中提供了更多数据)总结了检测器在加入合成图后的性能提升情况。通过引入 GenGA(蓝色高亮)和 CGenGA(红色高亮)生成的合成数据,所有检测器在五个有机数据集和三个注入数据集上的性能都有显著增强。我们观察到,在所有五个有机数据集和三个合成数据集上,所有检测器的性能都有显著提高。

值得注意的是,传统的三种 GNN 检测器(即 GCN、GAT 和 GraphSAGE)在所有四个评估指标上都有显著提升。这种显著的性能提升表明,通过在我们的合成数据上进行训练,这些 GNN 检测器在图异常检测中实现了更好的泛化能力,这些合成数据复制了给定图拓扑中的原始节点属性分布。

四种半监督/监督图异常检测器在所有指标上的性能提升幅度从0.1%到20%不等,而无监督检测器的 AUC 分数平均提高了4%以上。不同检测器的性能差距进一步表明,合成数据对检测器有不同的影响。我们推测,这可能是由于每种方法在学习数据分布和吸收合成信息方面的能力不同所致。总体而言,我们在八个数据集上的实验结果表明,我们生成的合成数据能够显著提高异常检测器的性能。

6.3 分类器引导对图生成的影响 (RQ2)

6.3.1 分类器引导对检测性能的影响

我们首先比较了 GenGA 和 CGenGA 之间的性能提升,来探讨分类器引导对图生成的隐性影响。通过表中的结果可以看到,源自预训练 GCN 分类器的类别信息可以进一步提升某些数据集上的检测性能。特别是在特定的数据集上,使用 CGenGA 生成的合成图相比 GenGA 带来了更好的检测效果。然而,总体来看,CGenGA 的性能提升与 GenGA 相差不大。我们认为这可能有以下两个主要原因:

- 尽管分类器引导可以为图生成注入标签信息,但这种标签信息隐性地限制了在已知标签条件下生成节点特征的多样性。当分类器提供具体标签时,生成的数据特征可能趋于更加集中于这些标签的分布,从而减少了生成数据的多样性。

- 预训练分类器的能力也会影响通过公式 (18) 派生的梯度信息 ,从而对生成特征的均值产生偏移。这意味着分类器的表现和能力也决定了生成图的质量和多样性。

与图像生成任务中的分类器引导不同,图像生成(如文献[5]中的 ResNet[14])能够准确预测不同的类别标签。在图异常检测中,我们期望图生成的复杂度更高,且异常节点的检测效果可以进一步提升。因此,如何更好地利用分类器引导生成高质量图仍是一个值得深入研究的方向。

6.3.2 分类器引导对生成图质量的影响

除了检测性能外,我们还通过 Fréchet Inception Distance (FID) 量化生成图的质量。FID 是一种用于衡量生成数据与真实数据分布相似性的广泛使用的测量方法,计算公式如下:

其中, 和 分别是原始数据和生成数据特征的均值, 和 是相应的协方差矩阵。直观地理解,FID 分数越低,表示生成数据与原始数据的分布越接近,质量越高。

从表6的结果可以看出,分类器引导能够在所有数据集上降低 FID 得分,尽管提升幅度不大。与我们之前对检测性能的分析类似,这种微小的提升可以归因于分类器提供的弱信息,而这些信息对生成图的整体影响较小,这也值得进一步深入研究。

6.4 残差连接的消融研究 (RQ3)

如第5.3节所述,我们在 SDN 和 DEN 之间设计了残差连接,目的是缓解在消息传递过程中节点表示的过度平滑现象。为了验证这种设计的有效性,我们在 Cora 数据集上进行了消融实验,比较了使用残差连接和不使用残差连接的 GenGA 生成的合成图对 GCN 性能的提升。具体来说,我们对比了使用残差连接的 GenGA 和不带残差连接的 GenGA w/o R(即没有残差连接的 GenGA)。如图4所示,带有残差连接的 GenGA 在所有评估指标上都优于 GenGA w/o R,这进一步验证了残差连接在提升检测性能中的有效性。

6.5 参数 的影响 (RQ3)

公式 (18) 中的超参数 控制分类器梯度的缩放。通过增加 的值,生成数据的均值会发生较大的偏移,而减小 则减少偏移。这意味着 在生成数据中的作用非常重要,因为它直接影响生成数据与原始数据分布的相似性。

为了评估 对生成数据质量的影响,我们在 Cora 和 Weibo 数据集上进行了实验,分别调整 的取值范围(从0.2到2.0),并测量 FID 分数。结果如图5所示,随着 的增加,Cora 数据集的 FID 分数也逐步增加,这表明过多的分类器信号会使生成数据偏离原始分布。然而,Weibo 数据集的结果显示,增加 反而降低了 FID 分数,这表明更大的分类器信号使生成数据与原始数据的分布更加接近。

通过比较两个数据集上 GCN 分类器的检测性能,我们观察到 GCN 在 Weibo 数据集上的表现优于 Cora。这暗示了 GCN 分类器能够更好地捕捉 Weibo 数据集上的数据分布特征,导致在这两个数据集上的 FID 分数差异。

6.6 噪声调度器的影响 (RQ4)

噪声调度器决定了在前向扩散过程中添加到节点特征上的噪声量。在本次实验中,我们研究了两种常用的噪声调度器(线性调度器和余弦调度器)对图异常检测性能的影响。我们在四个数据集上进行了实验,并在图7中展示了结果。具体来说,我们在两个噪声调度器下训练 GenGA,并进一步使用生成的图来训练 GCN 分类器。

结果显示,余弦调度器在大多数情况下表现优于线性调度器,特别是在 Reddit 数据集上的 F1 得分方面线性调度器稍稍占优。总体而言,余弦调度器表现更加稳定,在图生成过程中能更好地控制噪声的增加。

6.7 使用更多合成图对性能的影响 (RQ5)

对于 RQ5,我们研究了通过使用更多生成图进行训练是否能进一步提高检测器的性能。图6展示了在四个数据集上的结果,显示增加生成图的数量对性能提升有限,甚至在某些情况下(如 Cora 和 Weibo 数据集)还会导致检测性能的下降。

我们推测,这可能是由于生成图的多样性不足,生成的大量图并未能显著扩展现有数据集中的信息。这也表明,生成更加多样化的图将成为我们未来研究的重点,旨在提高数据的多样性,从而进一步提升检测器的性能。

6.8 时间成本 (RQ6)

我们在表7中报告了生成一个图所需的平均时间(以秒为单位)。结果显示,由于 GenGA 不涉及分类器信号,采样速度快于 CGenGA。尽管 CGenGA 在生成过程中包含了额外的分类器引导,但两种方法的图生成速度都非常高效。最坏情况下,生成一个图的时间不超过160秒,这意味着无论采用哪种方法,我们都能够快速生成图数据来增强现有检测器的性能。

7 结论

图异常检测在图机器学习的发展中取得了显著进展,但现有的工作主要集中于构建更强大的检测模型,而忽略了数据的稀缺性及由此引发的数据特定挑战,认为它是预先假定的条件。与现有工作相比,我们提出了一种新的基于数据的中心化方法,以缓解图异常检测领域中训练数据稀缺的问题。通过对前向图扩散过程的严格分析,我们确定了设计用于图生成的去噪神经网络的两个原则,并提出了 GenGA 和 CGenGA 来合成额外的图数据。我们在八个广泛使用的数据集上进行了大量实验,结果表明,使用我们生成的图数据可以进一步提升现有最先进检测器的性能,这展示了我们数据中心化方法的潜力。

限制与未来工作

从七个研究问题的案例研究中,我们揭示了模型设计潜在的改进方向,并明确了未来工作的研究方向,具体包括:

- 引入更有效的分类器引导机制以改进图生成;

- 改进采样速度/减少采样步骤;

- 提高生成图的多样性。